Séjour de recherche de Michael Karani au LPL

Nous avons le plaisir d’accueillir à nouveau Michael Karani, enseignant-chercheur à l’Université de Dar es Salaam en Tanzanie, du 9 au 27 octobre au LPL. Il enseigne dans les domaines de la linguistique et de la communication au Centre for Communication Studies.

Son séjour s’inscrit dans le projet « SYSORI : systèmes sonores des langues de la vallée du Rift » financé par le programme « CNRS-Africa Visiting Fellowships Programme » et dont il est co-porteur. Durant ces trois semaines sur Aix, un séminaire et des moments d’échange seront proposés aux collègues du LPL.

Voir aussi : https://www.lpl-aix.fr/actualite/nouvelles-du-projet-sysori-2022/

Nouveau financement : COSYSORI

En 2023, les partenaires du projet SYSORI ont obtenu un nouveau financement qui fait suite au premier programme :

COSYSORI : Contact dans les systèmes sonores des langues de la vallée du Rift – CNRS-Africa Visiting Fellowships

Porteurs du projet :

- Alain Ghio, LPL

- Michael Karani, Université de Dar es Salaam,Tanzanie

Membres :

- Didier Démolin, LPP

- Yohann Meynadier, LPL

- Francesca Di Garbo, LPL

- Maarten Mous, Univ. Leiden, Pays-Bas

- Andrew Harvey, University of Bayreuth, Allemagne

Résumé :

Le projet COSYSORI prolonge le projet SYSORI dont l’objectif est l’étude des Systèmes Sonores des langues de la vallée du Rift. L’aspect novateur consiste à mettre l’accent plus précisément sur les phénomènes de contact de langues tout en gardant les fondements des projets précédents.

Le Grand Rift Africain comprend plusieurs aires linguistiques appartenant aux quatre grandes familles linguistiques du continent (Afro-Asiatique, Niger-Kongo, Nilo-Saharienne et Khoesan). La diversité linguistique de cette zone est le résultat de migrations et de contacts, parfois très anciens, entre des populations de chasseurs-cueilleurs, d’éleveurs et d’agriculteurs. La comparaison entre les langues suggère plusieurs phases migratoires et contacts qui ont modifié à plusieurs reprises le paysage linguistique. Les systèmes sonores des langues du Rift ont des types de sons particuliers, dont certains ne sont pas courants dans les langues du monde. Le cas des consonnes non pulmoniques telles que les éjectives, les implosives et les clicks est particulièrement remarquable.

Ces consonnes sont-elles des substrats de très anciens éléments qui se reflètent dans les langues actuelles ou bien sont-elles le produit de mécanismes d’innovation et de complexification des systèmes sonores ? Existe-t-il un lien entre les clicks et les consonnes éjectives, pouvant expliquer par exemple le transfert d’une langue à une autre par contact ? Comment comparer ces consonnes non pulmoniques aux mécanismes de la déglutition ou de la toux, mettant ainsi en évidence la nature biologique d’éléments de la structure linguistique ?

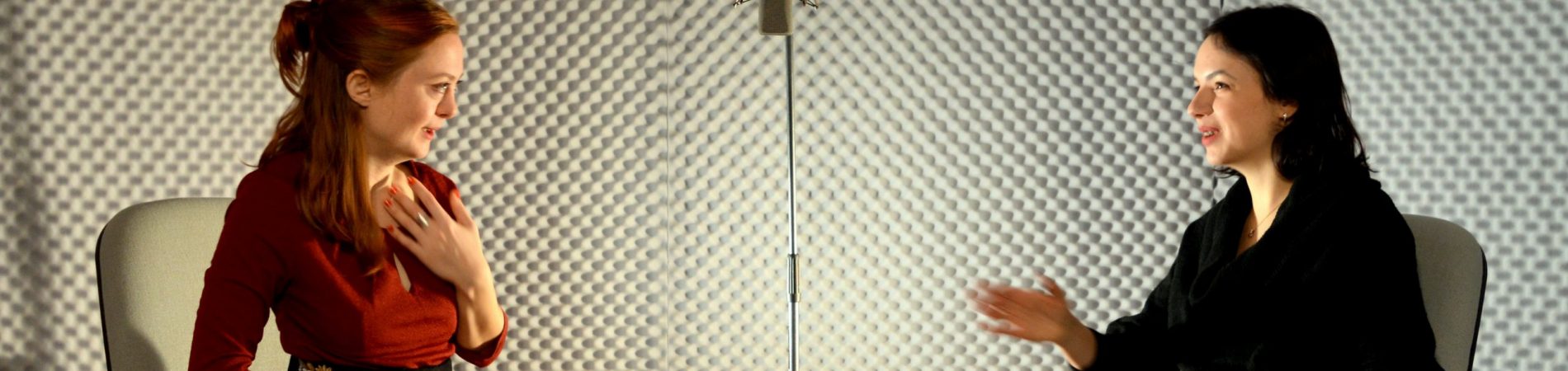

Image :

De gauche à droite : Michael Karani (UDSM), Didier Démolin (LPP), Loyewo (informateur sur Arusha), un locuteur Maasai anonyme, Alain Ghio (LPL) en Tanzanie en juin 2022

Crédits photo : Projet Sysori / A. Ghio et D. Demolin