Nous avons le plaisir de vous annoncer la publication de l’article « Automatic tool to annotate smile intensities in conversational face-to-face interactions » par Stéphane Rauzy (ingénieur de recherche CNRS) et Mary Amoyal (ancienne doctorante LPL) dans la revue Gesture.

Il est téléchargeable gratuitement sur la plateforme HAL : https://hal.science/hal-04194987/

Référence : Stéphane Rauzy, Mary Amoyal. Automatic tool to annotate smile intensities in conversational face-to-face interactions. Gesture, September 2023 ⟨10.1075/gest.22012.rau⟩. ⟨hal-04194987⟩

Résumé:

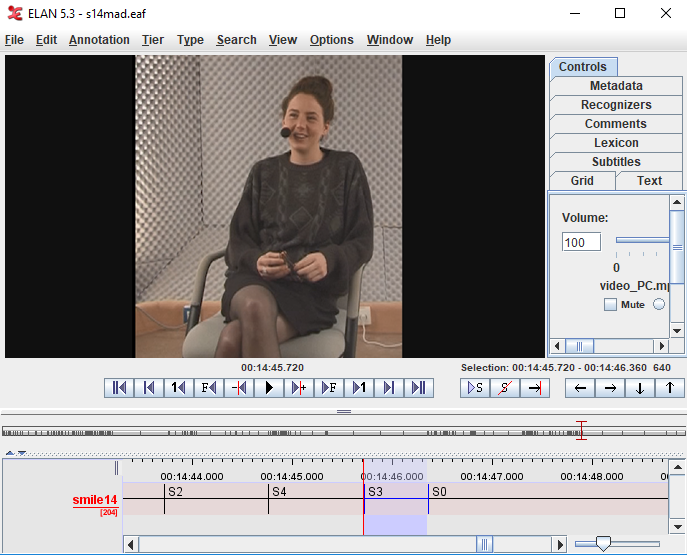

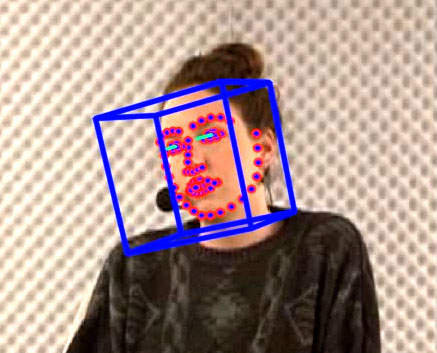

Cette étude présente un outil automatique qui permet de tracer l’intensité des sourires au cours d’un enregistrement vidéo d’interactions conversationnelles en face-à-face. La sortie traitée propose une séquence d’intervalles de temps adjacents étiquetés selon l’échelle d’intensité du sourire ( Gironzetti, Attardo, et Pickering, 2016 ), une échelle à 5 niveaux variant d’une expression faciale neutre à un rire. Le modèle statistique sous-jacent de cet outil est entraîné sur un corpus de conversations annoté manuellement présentant des expressions faciales spontanées. Ce modèle sera détaillé dans cette étude. Cet outil peut être utilisé avec bénéfice pour annoter le sourire dans les interactions. Les résultats sont doubles. Premièrement, l’évaluation révèle une concordance observée de 68% entre les annotations manuelles et automatiques. Deuxièmement, la correction manuelle des étiquettes et des limites d’intervalles des sorties automatiques réduit d’un facteur 10 le temps d’annotation par rapport au temps passé à annoter manuellement les intensités de sourire sans prétraitement. Notre moteur d’annotation utilise la boîte à outils OpenFace pour suivre le visage et mesurer les intensités des unités d’action faciales d’intérêt tout au long de la vidéo. La documentation et les scripts de notre outil, le logiciel SMAD, peuvent être téléchargés sur la page URL du projet open source HMAD https://github.com/srauzy/HMAD.

Crédits d’image : S. Rauzy & M. Amoyal